Regresión Lineal Múltiple: Descifrando las Relaciones Complejas

En un mundo inundado de datos, comprender las relaciones complejas entre variables es crucial para tomar decisiones informadas. La regresión lineal múltiple, una herramienta poderosa del análisis estadístico, nos permite desentrañar estas relaciones, brindándonos una visión profunda de cómo las variables interactúan y predicen el comportamiento de un fenómeno determinado.

Imagine un rompecabezas con muchas piezas. La regresión lineal múltiple, como un experto en rompecabezas, nos ayuda a identificar qué piezas encajan, cómo se relacionan y cuál es la mejor forma de ensamblarlas para obtener una imagen completa. En este caso, las piezas son las variables, y la imagen completa es la mejor predicción posible de la variable dependiente, también conocida como variable de respuesta.

¿Qué es la Regresión Lineal Múltiple?

La regresión lineal múltiple es un modelo estadístico que establece una relación lineal entre una variable de respuesta continua y dos o más variables predictoras. Estas variables predictoras pueden ser continuas, categóricas o incluso combinaciones de ambas, lo que permite modelar relaciones complejas y no lineales a través de técnicas de transformación.

En esencia, el modelo busca encontrar la mejor línea recta que se ajusta a los datos, considerando la influencia de todas las variables predictoras. Esta línea recta, llamada "recta de regresión", representa la relación predictiva entre las variables. En lugar de una sola línea recta, la regresión múltiple crea un hiperplano multidimensional, donde cada variable predictora representa una dimensión.

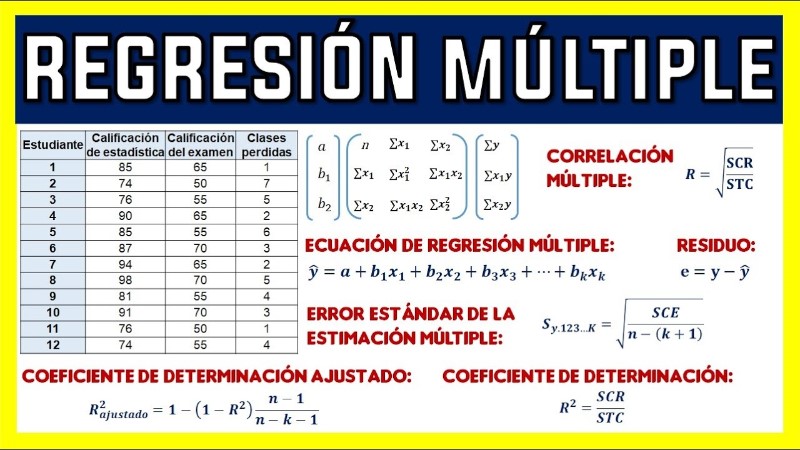

La ecuación de la regresión lineal múltiple se expresa como:

Y = β0 + β1X1 + β2X2 + ... + βnXn + ε

Donde:

- Y es la variable de respuesta.

- β0 es la intersección con el eje Y.

- β1, β2, ..., βn son los coeficientes de regresión para las variables predictoras X1, X2, ..., Xn.

- ε es el término de error, que representa la variabilidad no explicada por el modelo.

Los coeficientes de regresión (β) representan la importancia relativa de cada variable predictora en la predicción de la variable de respuesta. Un coeficiente positivo indica una relación directa, mientras que un coeficiente negativo indica una relación inversa. La magnitud del coeficiente indica la fuerza de la relación.

Aplicaciones de la Regresión Lineal Múltiple

La regresión lineal múltiple tiene un amplio espectro de aplicaciones en diversos campos, incluyendo:

- Negocios: Predecir las ventas, los ingresos, el precio de las acciones o la satisfacción del cliente.

- Ciencias Sociales: Estudiar la influencia de factores como la educación, el ingreso y la edad en el comportamiento de votación.

- Salud: Analizar la relación entre el estilo de vida, los factores genéticos y el riesgo de enfermedades.

- Ingeniería: Predecir la resistencia de los materiales o el rendimiento de los sistemas.

- Medio Ambiente: Modelar la concentración de contaminantes en el aire o el impacto del cambio climático.

Ejemplo: Predecir el Precio de una Casa

Imagine que quiere predecir el precio de una casa utilizando características como el tamaño, la ubicación y la antigüedad. La regresión lineal múltiple puede ser utilizada para modelar esta relación.

La variable de respuesta sería el precio de la casa, y las variables predictoras serían el tamaño, la ubicación (codificada como variables categóricas) y la antigüedad. El modelo resultante podría utilizarse para estimar el precio de una casa nueva basándose en sus características.

Por ejemplo, si el modelo establece que un aumento de 100 metros cuadrados en el tamaño de la casa aumenta el precio en $20,000, y que una ubicación privilegiada aumenta el precio en $30,000, entonces podemos utilizar estos coeficientes para predecir el precio de una casa con características específicas.

Pasos para construir un modelo de regresión lineal múltiple

La construcción de un modelo de regresión lineal múltiple implica varios pasos esenciales:

1. Recopilación de datos

El primer paso es recopilar datos relevantes para el análisis. Los datos deben ser precisos y representativos de la población de interés.

Es importante asegurarse de que los datos se recopilen de manera confiable y que no se introduzcan sesgos en el proceso de recopilación.

2. Exploración y preparación de datos

Una vez que se recopilan los datos, es necesario explorarlos y prepararlos para el análisis. Esto incluye la verificación de valores atípicos, la transformación de variables y la eliminación de variables irrelevantes.

La exploración de datos puede revelarnos patrones, tendencias y relaciones entre las variables, lo que nos ayuda a comprender mejor la naturaleza de los datos y a identificar posibles problemas.

3. Selección de variables

La selección de variables es un paso crucial en el proceso de modelado. Se deben elegir las variables que tienen una influencia significativa en la variable de respuesta y que contribuyen a la precisión del modelo.

Existen diferentes técnicas de selección de variables, como la selección hacia adelante, la selección hacia atrás y la selección stepwise, que pueden utilizarse para identificar el conjunto óptimo de variables predictoras.

4. Ajuste del modelo

Una vez que se seleccionan las variables predictoras, se ajusta el modelo de regresión lineal múltiple utilizando un software estadístico. El software calcula los coeficientes de regresión que minimizan la diferencia entre los valores predichos y los valores reales de la variable de respuesta.

El software también proporciona información sobre la calidad del ajuste del modelo, como el R² ajustado, el error estándar de la estimación y los valores p para los coeficientes de regresión.

5. Evaluación del modelo

Después de ajustar el modelo, es necesario evaluarlo para determinar su precisión y confiabilidad. Esto implica evaluar la significancia estadística del modelo, la precisión de las predicciones y la presencia de posibles problemas, como la multicolinealidad o la heterocedasticidad.

La evaluación del modelo nos ayuda a comprender si el modelo es adecuado para el propósito previsto y si se pueden confiar en sus predicciones.

6. Interpretación de los resultados

El último paso es interpretar los resultados del modelo de regresión. Esto implica analizar los coeficientes de regresión, el R² ajustado y los valores p para obtener insights sobre la relación entre las variables y la capacidad predictiva del modelo.

La interpretación de los resultados nos permite comprender la influencia de las variables predictoras en la variable de respuesta y a utilizar el modelo para tomar decisiones informadas.

Supuestos de la Regresión Lineal Múltiple

La regresión lineal múltiple se basa en ciertos supuestos que deben cumplirse para garantizar la validez de los resultados. Estos supuestos son:

- Linealidad: La relación entre la variable de respuesta y las variables predictoras debe ser lineal. Si la relación no es lineal, se pueden aplicar técnicas de transformación para linealizar los datos.

- Independencia: Los errores deben ser independientes entre sí. Esto significa que el error en una observación no debe estar relacionado con el error en otra observación.

- Normalidad: Los errores deben estar distribuidos normalmente. Esto puede verificarse utilizando pruebas estadísticas como la prueba de Shapiro-Wilk.

- Homocedasticidad: La varianza de los errores debe ser constante para todos los valores de las variables predictoras. La heterocedasticidad, que es la varianza no constante de los errores, puede afectar la validez de los resultados.

- Ausencia de multicolinealidad: Las variables predictoras no deben estar altamente correlacionadas entre sí. La multicolinealidad puede dificultar la estimación de los coeficientes de regresión y puede llevar a resultados imprecisos.

Si los supuestos no se cumplen, se pueden aplicar técnicas de corrección para mejorar la calidad del modelo, como la transformación de variables, la regresión robusta o el uso de métodos de ajuste alternativos.

Consideraciones Adicionales

Además de los supuestos mencionados, es importante tener en cuenta las siguientes consideraciones para construir un modelo de regresión lineal múltiple exitoso:

- Calidad de los datos: La calidad de los datos es fundamental para la precisión del modelo. Los datos deben ser precisos, completos y libres de errores.

- Tamaño de la muestra: Un tamaño de muestra suficientemente grande es necesario para obtener resultados confiables. Un tamaño de muestra pequeño puede llevar a resultados imprecisos y a errores en la estimación de los coeficientes de regresión.

- Interpretabilidad del modelo: El modelo debe ser interpretable y fácil de entender. Los coeficientes de regresión deben tener una interpretación clara y práctica.

- Validación cruzada: La validación cruzada es una técnica para evaluar la capacidad predictiva del modelo en datos nuevos. Se divide el conjunto de datos en subconjuntos, se ajusta el modelo en un subconjunto y se evalúa su rendimiento en los subconjuntos restantes.

Regresión Lineal Múltiple: Una Herramienta Esencial para la Toma de Decisiones

La regresión lineal múltiple es una herramienta poderosa que permite a los investigadores y profesionales comprender las relaciones complejas entre variables, realizar predicciones precisas y tomar decisiones informadas. Al comprender los supuestos, las limitaciones y las mejores prácticas, podemos aprovechar al máximo esta técnica para obtener insights valiosos a partir de los datos y mejorar nuestros procesos de toma de decisiones.

Preguntas Frecuentes sobre Regresión Lineal Múltiple

¿Qué es la Regresión Lineal Múltiple?

La Regresión Lineal Múltiple es una técnica estadística utilizada para predecir el valor de una variable dependiente (variable de destino) a partir de dos o más variables independientes (variables predictoras).

¿Cuáles son los supuestos de la Regresión Lineal Múltiple?

Los supuestos clave de la Regresión Lineal Múltiple incluyen:

- Linealidad: La relación entre la variable dependiente y las variables independientes debe ser lineal.

- Independencia: Los residuos (las diferencias entre los valores pronosticados y los reales) deben ser independientes entre sí.

- Normalidad: Los residuos deben estar distribuidos normalmente.

- Homocedasticidad: La varianza de los residuos debe ser constante para todos los valores de las variables independientes.

¿Cómo interpreto los coeficientes de regresión?

Los coeficientes de regresión representan el cambio en la variable dependiente por cada unidad de cambio en la variable independiente correspondiente, manteniendo las demás variables constantes.

¿Qué es el R² ajustado y cómo se interpreta?

El R² ajustado es una medida que indica la proporción de la varianza en la variable dependiente que es explicada por el modelo. Un R² ajustado más alto indica un mejor ajuste del modelo a los datos.

¿Qué es la prueba F y cómo se interpreta?

La prueba F se utiliza para determinar si el modelo en su conjunto es significativo. Un p-value bajo (generalmente menor que 0.05) indica que el modelo es significativo.

¿Qué es la regresión robusta?

La regresión robusta es una técnica que es menos sensible a los valores atípicos o errores en los datos.

¿Qué es Tobit Regression?

Tobit Regression es un modelo de regresión que se utiliza cuando la variable dependiente está censurada, es decir, que tiene un límite superior o inferior.

¿Cómo puedo validar la transformación de la variable respuesta?

Se puede validar la transformación de la variable respuesta estimando el intervalo de confianza del 95% del parámetro de transformación. Si el intervalo incluye 1, no hay evidencia suficiente para la transformación.